Wer kontrolliert die KI?

Generell bei KI-Systemen sowie insbesondere bei Hoch-

risiko-KI-Systemen gilt: Die Verantwortung darf nicht an das System delegiert werden.

Die KI-VO verlangt ausdrücklich, dass solche Systeme während ihrer gesamten Einsatzdauer einer wirksamen menschlichen Aufsicht unterliegen.

Mit dem Stichwort „Human-in-the-loop“ verbindet sich nicht nur eine formale Zuständigkeit, sondern die tatsächliche Fähigkeit natürlicher Personen,

- den Betrieb des Systems zu überwachen,

- KI-Ausgaben fachlich zu bewerten und

- bei Bedarf korrigierend einzugreifen.

Warum menschliche Aufsicht so wichtig ist

Gerade weil KI-Systeme Entscheidungen vorbereiten,

Muster erkennen oder Bewertungen vornehmen können, ist die menschliche Aufsicht ein zentrales Element belastbarer KI-Governance. Sie dient dazu,

- den laufenden Betrieb eines KI-Systems wirksam zu überwachen,

- die Validität und Plausibilität von KI-Ergebnissen

sicherzustellen, - Fehlentwicklungen, Verzerrungen oder risikobe-

haftete Ausgaben frühzeitig zu erkennen und - im Bedarfsfall einzugreifen oder die Nutzung

der KI auszusetzen.

Die Frage ist nicht nur, ob KI funktioniert, sondern auch, wer ihre Ergebnisse kontrolliert und wie diese Kontrolle organisatorisch abgesichert ist.

Regulatorische Anforderungen nach der KI-VO

Betreiber von Hochrisiko-KI-Systemen müssen sicherstellen, dass eine wirksame menschliche Aufsicht eingerichtet und dass der von der KI erzeugte Output valide ist.

Unternehmen müssen daher Verfahren schaffen, mit denen KI-Ergebnisse nicht automatisiert übernommen, sondern fachlich eingeordnet und geprüft werden.

Dazu gehören insbesondere:

- Benennung kompetenter Aufsichtspersonen

Es sind eine oder mehrere geeignete Personen auszuwählen, die mit der Aufsicht betraut werden und hierfür ausreichend Zeit sowie geeignete Arbeitsmittel erhalten.

(Art. 26 Abs. 2 und 4 KI-VO) - Laufende Überwachung des KI-Systems

Das System ist während seines Einsatzes fortlaufend zu überwachen. Die menschliche Aufsicht ist dabei ein Kernelement des Betriebs.

(Art. 26 Abs. 5 KI-VO) - Beschreibung der Aufsicht im Rahmen der

Grundrechtefolgenabschätzung

Soweit eine Grundrechtefolgenabschätzung erforderlich ist, müssen auch die vorgesehenen Maßnahmen zur menschlichen Aufsicht nachvollziehbar beschrieben werden.

(Art. 27 Abs. 1 lit. e KI-VO)

Menschliche Aufsicht ist damit ein wesentliches Instrument, um Fehlentscheidungen, Reputationsrisiken und regulatorische Verstöße zu vermeiden.

Anforderungen an die Sachkunde

Eine Aufsichtsfunktion kann nur dann wirksam wahrgenommen werden, wenn die zuständigen Personen über das notwendige Verständnis für Systemlogik, Risiken und regulatorische Anforderungen verfügen. Deshalb sollte auch der Fachbereich, der KI-Systeme nutzt, angemessen geschult sein, insbesondere in Bezug auf

- den Umgang mit KI-Systemen,

- die Bewertung von KI-Ergebnissen,

- Anforderungen der KI-VO sowie zum

- Rollen- und Verantwortungsverständnis.

Fazit:

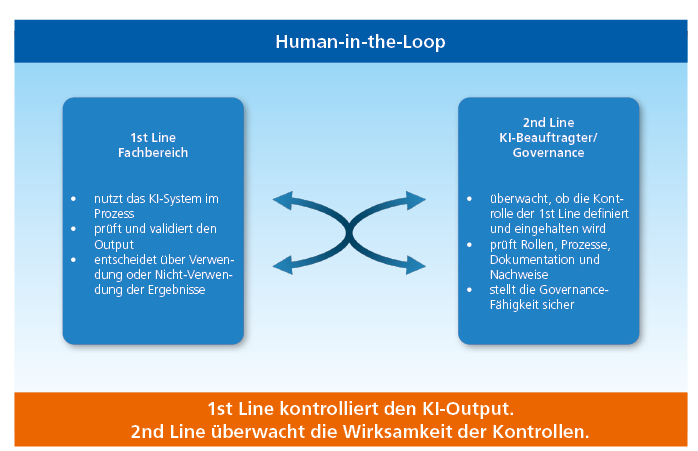

Die fachliche Kontrolle sollte dort stattfinden, wo die KI genutzt wird: im Fachbereich als 1st Line. Ergänzend braucht es eine Governance-Funktion, die überwacht, ob diese Kontrolle wirksam ausgestaltet ist. Nur so bleibt die Verantwortung für KI dort, wo sie hingehört: beim Unternehmen und bei den handelnden Personen – und nicht etwa bei der KI.

KI als Chance

Sie brauchen Unterstützung in der sicheren Anwendung der KI-Verordnung? Sie erwägen, einen KI-Beauftragten für Ihr Haus einzurichten, um einen sicheren Einsatz von KI zu gewährleisten? Unsere Mitarbeitenden sind bereits als KI-Beauftragte zertifiziert. Wir begleiten, beraten und schulen Sie in allen regulativen Fragen zum Einsatz von KI-Produkten.

Erfahren Sie mehr zu unseren Unterstützungsangeboten in der KI-Compliance.

Bleiben Sie auf dem Laufenden und registrieren sich jetzt für die KI-Fachinfo.

Sie haben Fragen ?

Wir unterstützen Sie gerne bei der Auswahl und dem

Einsatz von KI-Anwendungen.

Benjamin Wellnitz

Bereichsleiter IKT-Compliance & Datenschutz

Telefon: 069 580024-246

E-Mail: benjamin.wellnitz@dz-cp.de